Apple Intelligence、Googleの詐欺電話防止機能でプライバシーはどうなる?AIとエンドツーエンド暗号化(E2EE)の関係について

要約

この記事では、近年のエンドツーエンド暗号化(E2EE)の普及と、AIの発展が組み合わさることで生じる新たなプライバシーの課題について論じています。エンドツーエンド暗号化(E2EE)は重要な技術的進歩でしたが、一方でAIによる処理の外部化が進むことで、プライバシーを脅かす可能性が指摘されています。また、政府による暗号化されたデータへのアクセス要求など、プライバシーをめぐる社会的な問題にも触れられています。

詳細分析

主なポイント

- エンドツーエンド暗号化(E2EE)の普及と、AIの発展による処理の外部化が進むことで、プライバシーを脅かす可能性がある

- 政府による暗号化されたデータへのアクセス要求など、プライバシーをめぐる社会的な問題が生じている

- Apple社のプライベートクラウドコンピューティングなど、プライバシーを保護する技術的アプローチが登場している

社会的影響

- ユーザーのプライバシーが侵害される可能性がある

- 政府による監視強化につながる可能性がある

- 技術の発展と社会的価値観のバランスが問われる

編集長の意見

AIの発展とプライバシーの保護は、慎重に検討されるべき重要な課題であります。技術的な対策と社会的な合意形成が並行して進められる必要があるのですが、今はそうはなっていません。ユーザーの自己決定権を尊重しつつ、不正利用を防ぐための仕組みづくりが強く求められます。

本日は、記事の内容を元に、プライバシー問題について解説していきます。

解説

エンドツーエンドの暗号化(E2EE)とAI

まずは?

この記事を読み進めるにあたり、エンドツーエンドの暗号化(E2EE)というものを知っておいたほうがいいと思いますので、ここからはじめます。

「エンドツーエンド暗号化とは何か?」

エンドツーエンド暗号化(E2EE)は、送信者から受信者まで、データが途中で第三者に読み取られることなく、安全に届けられる通信方式です。メッセージアプリやメール、ファイル共有など、私たちの日常的なコミュニケーションを守る重要な技術として使われています。

この仕組みの特徴は、データが通信経路上のどのサーバーを通過しても、暗号化されたままの状態を保つことです。

サービス提供者でさえもメッセージの内容を読むことができません。

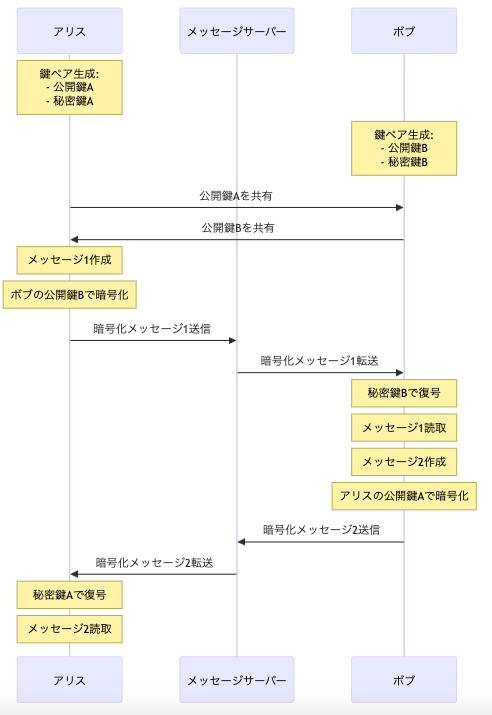

フローとしては、このようなやり取りがされています。

ステップバイステップでどのようなフローでエンドツーエンドが暗号化されて通信しているのか?をみていきましょう。

ステップ1: 鍵ペアの生成と交換

- 最初に、送信者と受信者それぞれが「公開鍵」と「秘密鍵」のペアを生成します

- 公開鍵は文字通り公開され、誰でも使用できます

- 秘密鍵は、自分だけが持ち、絶対に他人に渡してはいけません

ステップ2: メッセージの暗号化プロセス

- 送信者は、まず平文でメッセージを作成します

- 受信者の公開鍵を使って、そのメッセージを暗号化します

- この時点で、メッセージは受信者の秘密鍵でのみ復号可能な状態になります

ステップ3: 暗号化メッセージの送信

- 暗号化されたメッセージは、インターネット上のサーバーを経由して送信されます

- このとき、たとえサーバー管理者でも、メッセージの内容を読むことはできません

- メッセージは暗号化された状態のまま、受信者まで届きます

ステップ4: メッセージの復号

- 受信者は、届いた暗号化メッセージを自分の秘密鍵で復号します

- 復号に成功すると、元の平文メッセージを読むことができます

技術的な特徴として重要な点:

-

完全な転送経路の保護: メッセージは送信者のデバイスで暗号化され、受信者のデバイスで復号されるまで、常に暗号化された状態を保ちます。

-

前方秘匿性: 多くの現代的なエンドツーエンド暗号化(E2EE)システムでは、セッションごとに新しい鍵を生成する「前方秘匿性」という機能も実装されています。これにより、仮に一つのセッションの鍵が漏洩しても、過去や未来の通信は保護されたままとなります。

-

認証の重要性: 公開鍵が確かに意図した相手のものであることを確認する認証の仕組みも重要です。これにより「中間者攻撃」などを防ぐことができます。

実際の応用例:

- WhatsAppやSignalなどのメッセージングアプリ

- ProtonMailなどの暗号化メールサービス

- クラウドストレージサービスにおけるファイル保護

このように、エンドツーエンド暗号化は、現代のデジタルコミュニケーションにおいて、プライバシーとセキュリティを確保するための基盤技術として機能しています。特に、個人情報や機密情報のやり取りにおいて、その重要性は一層高まっています。

・・というすごく安全でプライバシーも守られているように見えますが、ここにAIが絡むと、どうして、危険になるのか?

記事の内容を見ると、

AIとエンドツーエンド暗号化(E2EE)の関係について

まず記事は、エンドツーエンド暗号化(E2EE)の基本的な役割から説明を始めています。2011年頃から、Signal、iMessage、WhatsAppなどのメッセージングアプリがエンドツーエンド暗号化(E2EE)を導入し始めました。これにより、サーバーがメッセージの平文を見ることができなくなり、ユーザーのプライバシーが大きく向上しました。

しかし現在、AIの急速な発展により、新たな課題が生まれています。最新のAIモデルは非常に強力な機能を持っていますが、そのほとんどが大量の計算能力を必要とします。一般的なスマートフォンではこれらのAIモデルを十分に動作させることができないため、クラウドサーバーでの処理が必要になってきています。

この状況は、エンドツーエンド暗号化(E2EE)が目指してきたプライバシー保護と相反する可能性があります。

なぜなら、AIによる処理のためにデータをサーバーに送信する必要があり、そのデータは平文である必要があるためです。

この課題に対して、Appleは「Private Cloud Compute」という解決策を提案しています。

これは特別な信頼されたハードウェアを使用して、データのセキュリティを確保しつつAIの処理を行う仕組みです。

完全な暗号化ほどの保証はありませんが、データの集中化によるリスクを軽減する試みとして評価できます。

Apple Intelligenceの発表の時にスライドまで使って説明していましたね。あれはこういうことがあるので、プライバシーも安全ですよ。ということを言ってたのです。

しかし記事は、より深刻な懸念も指摘しています。

将来的にAIエージェントが私たちの生活に深く組み込まれていく中で、これらのAIが本当に誰のために働くのかという問題です。

特に、法執行機関がこれらのAIエージェントを通じて個人データにアクセスすることを要求する可能性が懸念されています。

結論として、エンドツーエンド暗号化(E2EE)とAIの関係は、技術的な課題だけでなく、プライバシーと公共の利益のバランスという社会的な課題も含んでいることを指摘しています。

この問題は、今後の技術発展とともにますます重要になっていくと考えられています。

どういう問題が今懸念されているのか?それぞれ、この記事に出てきた、Apple Intelligence,Google,政府の軸で見ていきましょう。

Apple Intelligenceとプライバシーリスク

AppleIntelligenceとエンドツーエンド通信の関係について、プライバシーリスクを段階的に見ていきます。

従来のエンドツーエンド暗号化(E2EE)では、メッセージは送信者のデバイスで暗号化され、受信者のデバイスでのみ復号化されます。この過程で、サーバー側は暗号化されたデータしか見ることができません。これにより、通信内容のプライバシーが保護されてきました。

ステップ1: AppleIntelligenceの導入による変化 AppleIntelligenceは、AIを活用してユーザーのメッセージやデータを処理し、様々な機能を提供しようとしています。具体的には、テキストの要約、メッセージの自動返信、コンテンツの分析などが含まれます。

ステップ2: プライバシー侵害が起こり得るポイント

記事によると、以下の点でプライバシーの侵害リスクが発生します:

- デバイス上での処理限界:

- 多くのAIモデルは高い計算能力を必要とします

- 一般的なスマートフォンではこれらの処理を完全に行うことができません

- そのため、データをクラウドサーバーに送信して処理する必要が生じます

- サーバーでの処理における問題:

- AIによる処理のために、暗号化されたデータを一旦平文に戻す必要があります

- この時点で、データが第三者に露出するリスクが生まれます

- サーバー上では、ハッカーや内部関係者による不正アクセスの可能性があります

ステップ3: 具体的なプライバシー侵害シナリオ 記事では、以下のような状況が想定されています:

- メッセージの内容解析:

- AIが私的なメッセージの内容を理解し、要約や分析を行います

- この過程で、個人的な会話の内容が露出する可能性があります

- データの集中管理:

- AIは処理のために大量の個人データを集めることになります

- これにより、個人の行動パターンや思考傾向が把握される可能性があります

- 第三者によるアクセス:

- 法執行機関などが、このAIシステムを通じて個人データへのアクセスを要求する可能性があります

- ChatGPTの方に流れた時は、人が介在するので危険です

- システムが「違法コンテンツの検出」などの名目で監視に使用される可能性があります

ステップ4: Appleの対応策 記事では、Appleが「Private Cloud Compute」という解決策を提案していることも説明されています:

- 特別な信頼されたハードウェアを使用

- データの処理を安全な環境で行う

- サーバー間でのデータのロードバランシング

- ソフトウェアの透明性確保

しかし、これらの対策を講じても、完全な暗号化と同レベルのプライバシー保護は実現できない点が指摘されています。

結論として、AppleIntelligenceのような AIシステムは、エンドツーエンド暗号化の本来の目的(完全なプライバシー保護)と、高度なAI機能の提供という二つの要求の間でトレードオフを生じさせることになります。このバランスをどのように取るかが、今後の重要な課題となっています。

Googleの詐欺電話防止機能とプライバシーリスク

記事では、Googleの詐欺電話防止機能は、AIアシスタントシステムの例として、「電話の詐欺を検知して聞くシステム」という形で触れられています。

Apple Intelligenceを例に、Googleの詐欺電話防止機能のプライバシーへの影響について考えてみると、

- 音声データの処理

- 通話内容をリアルタイムで分析する必要がある

- この処理がデバイス上で行われるのか、クラウドで行われるのか

- 音声データの保存や管理方法

- AIモデルの処理要件

- 詐欺電話を検知するAIモデルの計算リソース要件

- ローカル処理とクラウド処理のトレードオフ

- プライバシーへの潜在的影響

- 通話内容の監視と分析

- 個人情報の取り扱い

- データの保存と管理

ということがポイントとなってきます。 どちらにしてもOpenな技術集団的なGoogleというイメージよりも、いかに広告につながるユーザーの行動データを作れるかのGoogleのイメージの方が最近は強くなってきましたので、気をつけてください。

政府のエンドツーエンド暗号化(E2EE)への介入?

最後に、この記事に出ていた、チャットコントロールについて見てみましょう。

- チャットコントロールの背景と概要 チャットコントロールは、EUで議論されている法案の一部で、暗号化された私的メッセージの自動スキャンを義務付けようとするものです。

- 児童性的虐待材(CSAM)の検出(既存のものと新たに作成されたもの両方)

- グルーミング行為(児童への性的搾取を目的とした働きかけ)の検出

- 音声やテキストの会話の監視

- EUの法案の特徴 EUの提案には以下のような要素が含まれているようです。

a) 対象となるコンテンツ:

- 既存のCSAM

- 新規に作成されたCSAM

- 音声会話

- テキストメッセージ

b) 検出手法:

- AIとMLを活用した自動スキャン

- テキスト解析

- 音声認識技術

- 会話内容の意味理解

- 現状について

- これらの提案は現時点ではまだ実装されていない

- 技術的な課題が実装の障壁となっている

- プラットフォーム企業からの抵抗がある

- 主な問題点と課題 EUで問題として挙げられている事項を整理してみました。

| 懸念点 | 説明 |

|---|---|

| プライバシーの侵害 | チャットコントロールは、裁判所の令状なしに、すべての市民のプライベートな電子通信を監視することを可能にします。これは、プライバシーの権利を侵害するものであり、EUの基本的人権憲章に違反します。 |

| セキュリティの低下 | チャットコントロールの実施には、エンドツーエンドの暗号化(E2EE)の弱体化が必要になる可能性があります。E2EEは、オンライン通信のセキュリティと機密性を確保するために不可欠です。E2EEを弱体化させると、サイバー犯罪者やその他の悪意のあるアクターがプライベートな通信にアクセスできるようになり、セキュリティリスクが高まります。 |

| 誤検知 | チャットコントロールに使用されるアルゴリズムは、エラーが発生しやすく、無害なコンテンツを児童性的虐待資料(CSAM)として誤ってフラグ付けする可能性があります。これは、無実の人々が不当に調査や起訴されることにつながる可能性があります。スイスでは、報告されたCSAMの80%が実際には無害であることが判明しています。 |

| 表現の自由の制限 | チャットコントロールは、自己検閲と、物議を醸す可能性のある話題に関する議論の抑制につながる可能性があります。人々は、監視されているという恐怖から、自分たちの考えや意見を自由に表現することをためらうかもしれません。 |

| 児童と虐待の被害者への害 | チャットコントロールは、被害者が助けを求めることを困難にする可能性があります。サポートグループやヘルプラインとの通信も監視の対象となる可能性があり、被害者は支援を求めることをためらうかもしれません。また、未成年者が自分の裸の写真を共有するセクスティングの犯罪化につながる可能性もあり、調査対象の約40%が未成年者であることが示されています。 |

| 技術的な非効率性 | ネットワークブロッキングは、チャットコントロールの一環として提案されており、技術的に効果がなく、回避が容易です。また、検閲インフラストラクチャの構築につながります。 技術的実現可能性として、AIモデルの処理能力要件などが考えられます。 |

| 匿名通信の終焉 | メッセージやチャットに年齢確認を義務付けることで、匿名通信は事実上禁止されます。これは、内部告発者、人権擁護者、疎外されたグループが依拠する匿名性の保護を損ないます。 |

| アプリストアの検閲 | チャットコントロールは、アプリストアでの検閲と、児童による多くのアプリのインストールの制限につながります。これは、子どもたちがデジタルの世界から排除されることにつながります。 |

| 透明性の欠如 | チャットコントロールに使用されるアルゴリズムは、一般に公開されておらず、科学コミュニティもアクセスできません。エラー率は不明であり、規制案では制限されていません。 |

- 将来的な懸念 こうやってEUの動きを見て整理してみると、重要な懸念が沸いてきました。

- AIエージェントの発展により、より広範な監視が技術的に可能になる

- 法執行機関がAIエージェントを通じて個人データにアクセスする可能性

- プライバシーと公共の利益のバランスが崩れる可能性

- 監視の範囲が徐々に拡大していく可能性

などが考えられます。

総合してみると、

エンドツーエンド暗号化という(E2EE)というプライバシー向上とセキュリティの確保された技術。

そこにAIが絡んでくると、今回見てきたような懸念がどんどん広がってくるという事実。

AIに慣れてきてしまった人々。

崩れるしかないという流れ。

そこに政府の介入。

もう、個人間の安全を守ってくれていた、エンドツーエンド暗号化(E2EE)というのはなくなっていくのでしょうか?

この記事を読んでいて、これが「いま」を表していることの1つなのだと考えさせられました。

サイバー脅威というと、攻撃者と防御者だけで語られますが、

それは企業や組織という、生身でない人格に対する脅威であって、

そういったニュースの仕方のせいで、企業名ばかり目立ってますが、

そこで漏れてる情報のほとんどは、顧客リストとか呼ばれている「個人の情報」なのです。

ほんとうにしっかりと見つめないといけないのは、

直接、攻撃してくる攻撃者がいなくても、ビックテックとビッグブラザーにまで脅かされている、生活者である「われわれ」なのです。

これを忘れないようにしてください。

背景情報

- 2011年頃から、メッセージングアプリなどでデフォルトのエンドツーエンド暗号化(E2EE)が導入されるようになった

- スマートフォンの性能向上に伴い、AIを活用したさまざまな機能が登場している

- 欧州では、暗号化されたメッセージの自動スキャンを義務付ける法案が議論されている