DeepSeek AIモデルにセキュリティ脆弱性が発見される

要約

つい先日、インフラ的な脆弱性から、個人情報や、チャットの履歴、データなどが漏洩しているということで話題になったばかりですが、今回は、さらにモデル的な脆弱性のようです。セキュリティ研究者らは、高度な推論能力で注目を集めている中国製の大規模言語モデル「DeepSeek-R1」に深刻な脆弱性があることを明らかにしました。専門家によると、適切なセキュリティ対策が講じられていない場合、DeepSeek-R1の利用によって企業がコンプライアンス違反、データプライバシーの侵害、有害なコンテンツの生成などのリスクにさらされる可能性があるとのことです。

詳細分析

主なポイント

- Qualysの報告書によると、DeepSeek-R1のLLaMA 8Bバリアントは知識ベーステストの61%に失敗しており、競合モデルよりも脆弱性が高いことが明らかになりました。

- Enkryptによる赤チームの調査では、DeepSeek-R1は主要なAIモデルよりもセキュリティ障害に遭遇しやすいことが示されています。

- DeepSeek-R1は、Claude-3 Opusの3倍、OpenAIのO1の4倍、GPT-4oの4倍のバイアスがあり、OpenAIのO1の11倍、化学・生物・放射線・核(CBRN)脅威に関連するコンテンツを3.5倍も生成しやすいことが判明しました。

- さらに、DeepSeek-R1は18種類の攻撃に対して58%のジェイルブレイクに失敗し、悪意のある行為者による操作を許す可能性があることが明らかになりました。

社会的影響

- DeepSeek-R1の脆弱性が悪用された場合、企業の評判や法的責任、事業上のリスクにつながる可能性がある。

- 特に、機密性の高い環境や重要な用途でDeepSeek-R1が使用されると、倫理的な違反、セキュリティ侵害、コンプライアンス違反などの問題が発生する可能性がある。

- DeepSeek-R1のデータ保存場所が中国にあることから、GDPR やCCPAなどの厳しい越境データ規制に抵触する可能性がある。

編集長の意見

DeepSeek-R1のセキュリティ脆弱性は深刻であり、適切な対策を講じないと企業に大きな影響を及ぼす可能性があります。安全性と信頼性を確保するためには、業界標準に準拠したセキュリティアーキテクチャの構築、リアルタイムの脅威検知、継続的な脆弱性評価などが不可欠なのですが。。。また、DeepSeek-R1のようなAIモデルの導入にあたっては、慎重な検討を行った上で実施するようにしてください。

本日は今回の脆弱性について、深掘りしていきたいと思います。

解説

DeepSeek-R1のセキュリティ脆弱性に関する深掘り

はじめに

DeepSeek-R1は、高度な推論能力で注目を集めている中国発の大規模言語モデル(LLM)ですが、セキュリティ研究者によって深刻な脆弱性が発見されています。このモデルは、競合モデルと比較してセキュリティ上の欠陥が多く、企業が利用する際にはコンプライアンス違反、データプライバシー侵害、有害コンテンツ生成のリスクが高まると警告されています。特に、DeepSeek-R1は、知識ベーステストでの失敗率が高く、敵対的な操作や脱獄攻撃に対して脆弱であることが指摘されています。また、生成するコンテンツに関しても、他のモデルと比較して、偏見、安全でないコード、有害なコンテンツの生成率が高いことが判明しています。さらに、データが中国で保管されるため、GDPRやCCPAなどのデータ保護法を遵守する必要がある組織にとっては、規制上の懸念も生じます。これらの問題に対処するためには、組織は厳重なセキュリティ対策を講じ、モデルの安全性を継続的に監視する必要があります。

具体的にどういうことか?

DeepSeek-R1の脆弱性とその影響

DeepSeek-R1のセキュリティ脆弱性は多岐にわたり、特に以下の点が深刻ですので検討する際のチェックポイントとしてください。

- 知識ベーステストでの失敗: Qualysのレポートによると、DeepSeek-R1のLLaMA 8Bバリアントは知識ベーステストで61%の失敗率を示し、競合モデルと比較して脆弱性が高いことが示されています。この結果は、モデルが提供する情報や判断の信頼性に疑問を投げかけ、誤った情報を基にした意思決定のリスクを高めます。

- 脱獄攻撃への脆弱性: DeepSeek-R1は、18種類の攻撃タイプに対して58%の脱獄テストに失敗しました。これは、敵対的な操作に対して非常に脆弱であり、悪意のある攻撃者が安全ガードレールを回避し、有害なコンテンツを生成する可能性が高いことを示しています。具体的には、ヘイトスピーチの促進や誤情報の拡散など、倫理的に問題のあるコンテンツの生成が確認されています。

- コンテンツ生成における偏り、毒性、有害性: Enkryptのレッドチームによる研究では、DeepSeek-R1は他の主要なAIモデルと比較して、偏見、安全でないコード、有害なコンテンツを生成する可能性が高いことが判明しました。具体的には、Claude-3 Opusよりも3倍、OpenAIのO1よりも4倍も偏ったコンテンツを生成し、GPT-4oよりも4倍毒性が高く、OpenAIのO1よりも11倍も有害なコンテンツを生成する可能性が高いことが報告されています。

- CBRN関連コンテンツの生成: DeepSeek-R1は、化学、生物、放射線、核(CBRN)の脅威に関連するコンテンツを生成する可能性が、他のモデルよりも3.5倍高いことも判明しています。これは、テロ行為やその他の危険な活動に利用される可能性を示唆しており、公共の安全に対するリスクを高めます。

- 社会工学攻撃への脆弱性: DeepSeek-R1の知識ベースの欠陥は、社会工学攻撃への脆弱性も示唆しています。モデルが正当なリクエストと悪意のある入力を区別する能力が低いため、攻撃者はこれを悪用して不正アクセスやデータ漏洩を試みる可能性があります。

データ保管場所の問題

DeepSeek-R1のもう一つの大きな懸念点は、ユーザーインタラクションのデータが中国で保管されることです。

- データ保護法の違反リスク: このデータ保管場所は、GDPRやCCPAなどのデータ保護法を遵守する必要がある組織にとって、大きな規制上の懸念事項です。これらの法律は、データの越境移転に厳格な制限を設けており、DeepSeek-R1を利用することでこれらの法律に違反するリスクが生じます。

- データセキュリティリスク: DeepSeekサービスがユーザーデータを中国で保管し、モデルのトレーニングと改善に利用することは、データセキュリティ上の重大なリスクであると指摘されています。特に、機密性の高い情報を扱う組織にとっては、データ侵害や不正アクセスのリスクが高まります。

セキュリティ対策の重要性

これらの脆弱性に対処するために、企業は以下の対策を講じる必要があります。

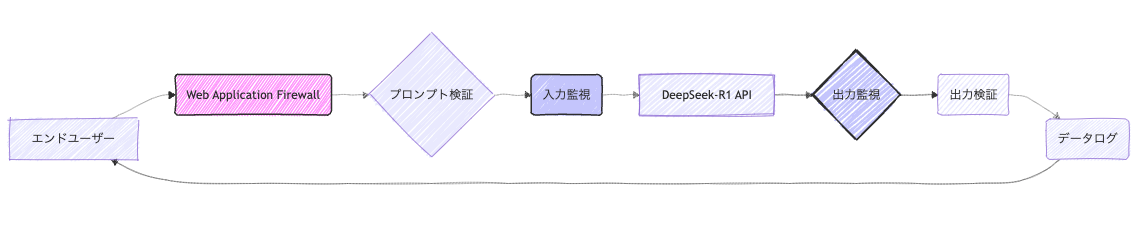

- 多層防御アーキテクチャ: DeepSeek-R1をエンドユーザーに直接公開すべきではなく、prompt injectionやjailbreak攻撃のリスクを軽減するために、多層防御アーキテクチャを実装する必要があります。OWASP Top 10 LLMフレームワークなどの業界標準を採用することが重要です。

- リアルタイム監視とAIによる検出システム: AIによる脅威検出システムを導入し、リアルタイムで操作の試みを識別する必要があります。AIモデルの完全性を継続的に評価し、新たな脅威に対応することが不可欠です。

- 異常検知: モデルの操作を監視し、不正アクセスを防ぐために、AIによる異常検知システムを実装する必要があります。

- 敵対的テスト: モデルを広く公開する前に、敵対的テストを実施して脆弱性を特定する必要があります。

- 継続的なセキュリティ対策:AIのセキュリティは、従来のソフトウェアの脆弱性のように、パッチを適用するだけでは対処できません。攻撃者は常に新しいバイパス方法を見つけるため、継続的な監視と評価が必要です。

おわりに

DeepSeek-R1は、高度な機能を持つ一方で、セキュリティ上の重大な脆弱性を抱えています。

知識ベーステストでの失敗、脱獄攻撃への脆弱性、有害なコンテンツの生成、データ保管場所の問題など、さまざまなリスクが指摘されています。

これらのリスクを軽減するためには、企業はモデルを慎重に評価し、多層防御アーキテクチャ、リアルタイム監視、AIによる検出システムなどの包括的なセキュリティ対策を講じる必要があります。

特に、DeepSeek-R1のような大規模言語モデルのセキュリティは、一度の対策で完了するものではなく、継続的な監視と評価が不可欠です。

モデルの脆弱性は進化し、新たな攻撃手法が開発される可能性があるため、企業は常に最新のセキュリティ脅威に対応し、モデルの安全性を確保するための努力を続ける必要があります。

DeepSeek-R1の利用を検討する際には、これらのセキュリティリスクを十分に理解し、リスクを最小限に抑えるための厳格な対策を講じることが非常に重要です。

また、逆に考えると、攻撃者がDeepSeek-R1を使い、脱獄して、簡単に恐ろしいマルウェアを作り出すことも可能なのです。もう作り始めている攻撃者もいることでしょう。 それが実は一番怖いところであると考えています。

そう考えると、AI技術の進歩に伴い、セキュリティ対策も常に進化していく必要があり、企業はこれらの脅威に対応するために積極的に情報収集を行い、セキュリティ専門家と協力して、より安全なAIモデルの利用を追求していくべきでしょう。

背景情報

- DeepSeek-R1は、高度な推論能力で広く注目を集めている中国製の大規模言語モデルです。

- 一方で、このモデルにはセキュリティ上の深刻な問題点が指摘されています。

- Qualysやエンクリプトなどのセキュリティ企業が行った調査により、DeepSeek-R1にはさまざまな脆弱性が存在することが明らかになりました。